Un nuevo algoritmo que repara imágenes en un solo paso

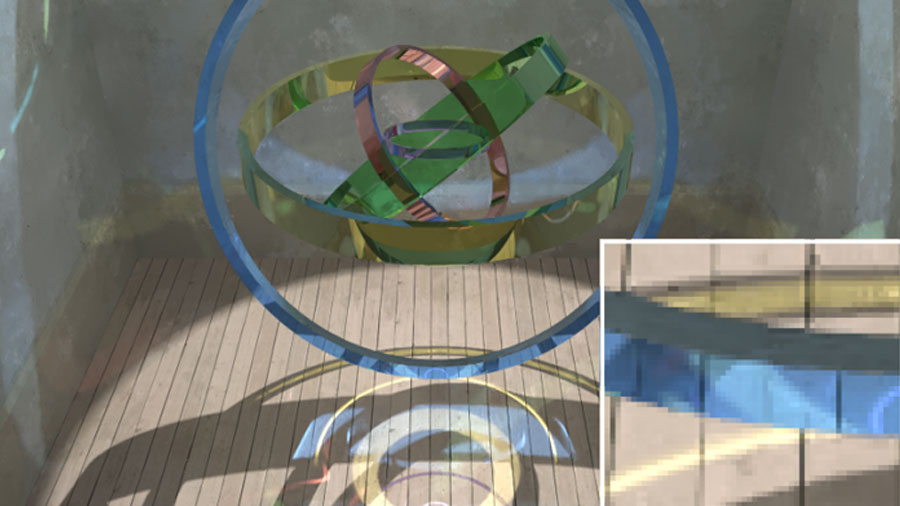

Las imágenes digitales llegaron para quedarse y se pueden tomar de cámaras, dispositivos de escaneo y teléfonos. Sin embargo, este tipo de imágenes tienden a ser imperfectas por muchas razones: la calidad de la cámara, de sus lentes, de su hardware y su software también, que se reflejan en imágenes desenfocadas, pixeles perdidos y corrupción del color.

Pero ahora un grupo liderado por científicos de la Universidad de Maryland, han diseñado un nuevo algoritmo que incorpora redes neuronales artificiales para aplicar simultáneamente una serie de correcciones a las imágenes corrompidas por alguna razón. Como el algoritmo puede “entrenarse” para reconocer la imagen que debe ser ideal. De hecho es capaz de corregir múltiples problemas en una sola imagen.

El equipo de investigación, en donde también hay científicos de la Universidad de Berna, en Suiza, probaron el algoritmo tomando fotos de alta calidad, sin que estén corrompidas, e introduciendo degradaciones severas, entonces con el algoritmo repararon la imagen. En muchos casos, el algoritmo incluso fue mejor que otras técnicas usadas con este mismo propósito.

Los investigadores presentaron sus hallazgos el 5 de diciembre en la 31 Conferencia sobre procesamiento de redes neuronales y sistemas afines, que se lleva a cabo en Long Beach, California. “Tradicionalmente, se han usado herramientas que tratan los problemas en las imágenes de forma separada. Cada una de estas herramientas asume cosas sobre cómo debe ser una buena imagen, pero esto tiene que programarse a mano en los algoritmos”, dice Matthias Zwicker, Profesor de Ciencias de la Computación en la Universidad de Maryland y autor senior de la presentación de la investigación. “Recientemente, las redes neuronales artificiales han sido aplicadas para resolver los problemas uno a uno. Pero nuestro algoritmo va un paso más allá, y puede resolver una variedad de problemas al mismo tiempo”, indica.

Las redes neuronales artificiales son el tipo de algoritmos de la inteligencia artificial modelados en la estructura de las neuronas, las células que se encuentran en el cerebro humano. Las redes artificiales pueden ensamblar patrones de comportamiento basándose en la entrada de datos, en un proceso que se parece a la manera en como el cerebro humano aprende nueva información. Por ejemplo, los cerebros humanos pueden aprender un nuevo lenguaje a través de exposición repetida a palabras y oraciones en contextos específicos.

Zwicker y colegas pueden “entrenar” su algoritmo exponiendo éste a una gran base de datos de imágenes que no están corrompidas y que son de alta calidad, ampliamente usadas en la investigación de las redes neuronales artificiales. Debido a que el algoritmo puede tomar muchos datos y extrapolar los parámetros complejos que definen las imágenes -incluyendo variaciones en la textura, color, luz, sombras y bordes- es capaz de predecir lo que debe ser una imagen no corrompida idea. Puede entonces reconocer desviaciones de estos parámetros en la imagen que analiza.

“Este es un elemento clave. El algoritmo necesita ser capaz de reconocer una buena imagen sin degradaciones. Pero para una imagen ya degradada, no puede saber cómo es que se debería ver, dice Zwicker, quien también trabaja en la Universidad de Maryland. “Por ende, primero entrenamos el algoritmos sobre la base de datos de imágenes de alta calidad. Entonces podemos dar una imagen corrompida y el algoritmo la modificará para modificar las imperfecciones”.

Zwicker indica que hay muchos grupos de investigación que trabajan en esta misma línea y que han diseñado algoritmos que logran resultados similares. Pero el algoritmo usado por los investigadores de Maryland han hallado que al corregir una imperfección da pie a corregir otras, de forma automática. Por lo tanto, la propuesta parece sentar las bases a una nueva explicación teórica y así han creado un algoritmo por demás efectivo.

“Cuando se tiene una imagen con ruido, aparentemente sólo se ha modificado algún parámetro de la alta calidad. Otras degradaciones, como el desenfoque en la imagen diverge del ideal en un subconjunto de dimensiones. “La labor es revelar cómo se puede corregir el ruido y llevar las dimensiones a su situación ideal, permitiendo trabajar simultáneamente sobre otros tipos de aberraciones visuales”, dice Zwicker.

El investigador piensa que aunque se tiene un nuevo algoritmo, el cual ha demostrado ser muy poderoso, todavía hay espacio para mejoras. Actualmente el algoritmo reconoce estructuras de bajo nivel en la imagen, pero se espera que pronto puedan incluirse texturas complejas como cabello y agua, por ejemplo.

El artículo de investigación: “Deep Mean-Shift Priors for Image Restoration“, de Siavash A. Bigdeli, Meiguang Jin, Paolo Favaro y Matthias Zwicker, se presentó el 5 de diciembre en la 31st Conference on Neural Information Processing Systems in Long Beach, California.

Fuente: unocero.com