Figure 01: la tecnología de OpenAI consigue que un robot responda y actúe como humano

El funcionamiento de Figure 01 está basado en redes neuronales y en un modelo de lenguaje visual desarrollado por OpenAI

Un modelo de inteligencia artificial (IA) desarrollado y entrenado por OpenAI ha dotado de capacidades de razonamiento visual y comprensión del lenguaje a Figure 01, robot humanoide que puede mantener conversaciones naturales y ejecutar acciones tal y como lo haría un humano.

El androide fue producido por Figure, una compañía estadounidense de robótica que pretende acelerar la producción a escala de autómatas con forma humana. La intención es encomendar a estas máquinas de uso general actividades rutinarias o riesgosas. Brett Adcock , fundador y director ejecutivo de la empresa, sostiene que “sólo en Estados Unidos hay más de 10 millones de empleos inseguros o indeseables. El envejecimiento de la población sólo hará que a las empresas les resulte cada vez más difícil ampliar su fuerza laboral. Si queremos un crecimiento continuo, necesitamos más productividad, y esto significa más automatización”.

La firma ha pactado diversas alianzas con grandes corporaciones tecnológicas para cumplir su objetivo. La semana pasada anunció el cierre de una ronda de financiación por 675 millones de dólares. Microsoft, Nvidia y OpenAI formaron parte del grupo de inversores. El acuerdo entre la organización dirigida por Sam Altman y Figure ha entregado el primer resultado satisfactorio.

El funcionamiento de Figure 01 está basado en un modelo grande de lenguaje visual (VLM, por sus siglas en inglés) y redes neuronales que operan de extremo a extremo para controlar los movimientos del robot. La combinación de ambos elementos permiten al desarrollo comprender su entorno y las conversaciones para actuar en consecuencia.

Los desarrolladores explican que el algoritmo de OpenAI se encarga de razonar el contexto y diseñar un plan de respuesta. Las redes neuronales pre entrenadas con imágenes y acciones definidas ejecutan la idea al impulsar movimientos robóticos rápidos, de bajo nivel y diestros.

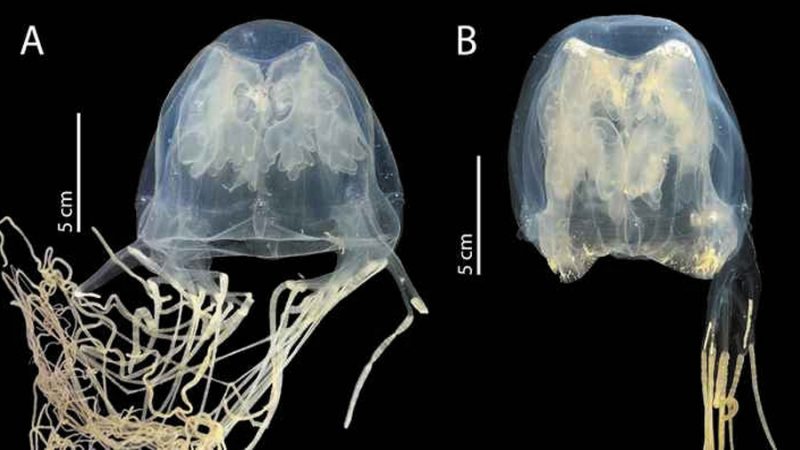

Un video publicado por Figure muestra el resultado del avance. El androide interactúa con un humano que le pide describir su entorno. “Veo una manzana roja sobre un plato al centro de la mesa, un escurridor con platos y vasos y a ti parado cerca con una mano en la mesa”, responde. El interlocutor solicita algo de comer. Figure 01 toma la manzana, la entrega y argumenta su acción diciendo que es lo único comestible que hay sobre el tablón. La compañía asegura que la demostración fue grabada en tiempo real y a velocidad promedio. El video no fue editado.

¿Cómo funciona Figure 01?

La parte superior del robot integra un gran cantidad de cámaras, micrófonos y sensores que le permiten registrar los elementos del ambiente. La información es procesada por el VLM para que las redes neuronales puedan captar imágenes integradas a 10 hercios (Hz) y generar acciones de 24 grados de libertad (posturas de muñeca y ángulos de las articulaciones de los dedos) a 200 Hz. “Todos los comportamientos están impulsados por políticas visomotoras de redes neuronales, que asignan píxeles directamente a acciones”, puntualizó Corey Lynch, director de IA en Figure.

Añadió que el algoritmo creado por OpenAI transcribe a texto las instrucciones o conversaciones captadas en audio por los micrófonos del androide. Procesa los datos recibidos, los combina con sus registros de entrenamiento y genera respuestas lingüísticas que se entregan al interlocutor mediante un mecanismo que convierte el texto en voz.

«El mismo modelo es responsable de decidir qué comportamiento aprendido debe ejecutar en el robot para cumplir un comando determinado, cargar la tarea de las redes neuronales en la GPU y efectuar una política determinada”, detalló. El VLM es el cerebro de Figure 01. Lo capacita para describir su entorno, razonar para tomar decisiones con sentido común y responder a solicitudes ambiguas. Las redes neuronales emulan al sistema nervioso. Envían las señales adecuadas para impulsar un movimiento.

Adcock sugiere que desarrollos como Figure 01 presentan una oportunidad sin igual para aumentar la productividad y la calidad de vida a nivel mundial. Anticipa que los robots capaces de pensar, aprender, razonar e interactuar con su entorno podrán realizar muchas tareas con mayor eficiencia y eficacia que los humanos. “Hoy en día, la remuneración del trabajo manual es el principal impulsor de los precios de los bienes y servicios. Representa alrededor del 50% del Producto Interno Bruto mundial, pero a medida que estos robots se ‘unan a la fuerza laboral’ en todas las industrias, el costo de la mano de obra disminuirá hasta que sea equivalente al precio de alquilar un robot, lo que facilitará una reducción integral de costos a largo plazo”.

Este escenario está aún lejos, según el informe ‘Beyond AI Exposure: Which Tasks are Cost-Effective to Automate with Visión Artificial?’ elaborado por el Instituto Tecnológico de Massachusetts. El estudio indica que pese a las inquietudes sobre una sustitución masiva de humanos en los puestos de trabajo, solo el 23% de aquellos relacionados con tareas de visión por computadora puede ser automatizados con IA. Para las compañías de la mayoría de los sectores aún es más beneficioso económicamente contratar personas que implementar sistemas inteligentes para realizar tareas cotidianas.

Fuente: es.wired.com