El físico advirtió de que la Inteligencia Artificial podría resolver la pobreza mundial pero le preocupaba que los humanos la usaran mal

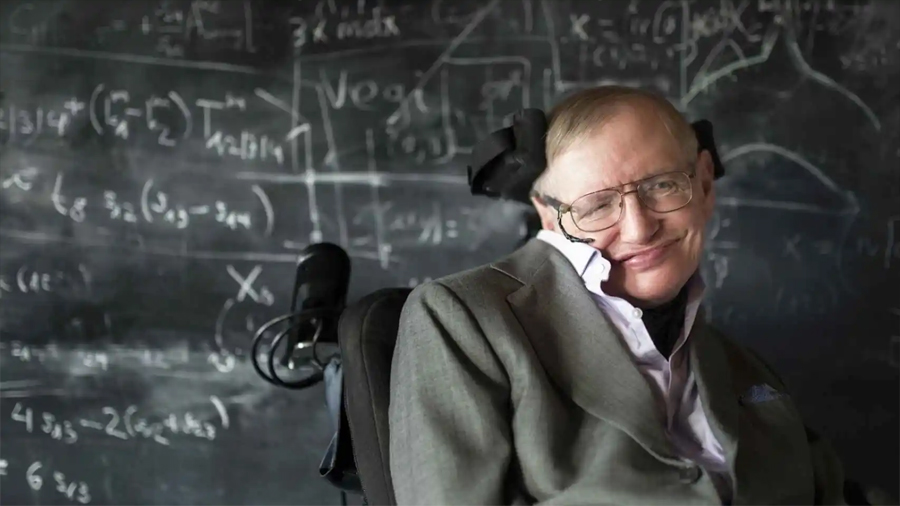

Stephen Hawking ha sido una de las mentes más brillantes de las últimas décadas. Murió en el 2018 y, por tanto, no ha podido ver cómo se han popularizado los chats de Inteligencia Artificial (IA) que ahora cualquiera puede usar en su día a día.

Eso sí, el científico imaginó que algún día esto pasaría y dejó ciertas declaraciones sobre las consecuencias que él pensaba que tendrían para todos nosotros. Algunas de ellas, muy positivas, pero otras no tanto. Antes de morir, pidió reflexionar bien sobre este tema.

Tan sólo dos años antes de su muerte, Hawking habló en la Universidad de Cambridge sobre la IA. «El éxito en la creación de la IA puede ser el mayor evento en la historia de nuestra civilización», comenzó este científico.

A continuación, añadió una advertencia: «Pero también podría ser el último, a no ser que aprendamos a evitar los riesgos. Junto a los beneficios, la IA también trae consigo peligros como poderosas armas autónomas o nuevas maneras de oprimir a la mayoría».

Problemas con los que poco a poco nos estamos familiarizando y Hawking ya avanzó. «No podemos predecir lo que lograremos cuando nuestras mentes se vean amplificadas por la IA», reflexionó entonces el famoso físico.

«Quizás con las herramientas de esta nueva revolución seremos capaces de deshacer algunos de los daños infligidos a la naturaleza por la última industrialización. Y seguro que conseguiremos finalmente erradicar la enfermedad y la pobreza», señaló.

El científico, por tanto, habló de grandes esperanzas y miedos sobre qué podría traer un futuro en el que la IA es omnipresente. Sí, hay razones para la esperanza, pero Hawking empezó su discurso diciendo: «La historia, aceptémoslo, es la historia de la estupidez».

El futuro que vendrá

Por eso, el científico celebró que se investigara «la inteligencia», pero teniendo en cuenta la tendencia de los humanos, le preocupó la aplicación de la misma. «Los logros que ya hemos visto palidecerán comparado con lo que está por venir en las próximas décadas».

«Va a introducir una gran disrupción en nuestra economía», señaló. Y lo que también le preocupó entonces es que la IA llegase a ganar un buen grado de autonomía. «En el futuro, la IA podría desarrollar su propia voluntad, una voluntad que esté en contra de la nuestra».

Hawking incidió sobre la necesidad de estudiar concienzudamente la IA, su enorme capacidad y sus riesgos antes de dejar que lo inunde todo en nuestro día a día. «La inteligencia es central en lo que significa ser humano», dijo.

«Todo lo que nuestra civilización ha conseguido es producto de la inteligencia humana, desde aprender a manipular el fuego y a cultivar comida hasta entender el cosmos», señala este investigador. Un camino impresionante que nuestra especie ha hecho sola.

«Pienso que no hay una diferencia muy profunda entre lo que puede alcanzar un cerebro biológico y lo que se puede alcanzar utilizando un ordenador. Ahora los ordenadores pueden, en teoría emular la inteligencia humana e, incluso, excederla», dijo.

Ya en 2016 Hawking explicó que la investigación en IA estaba progresando de una manera rápida y que se estaban dedicando a la misma enormes cantidades de dinero en inversión para desarrollar esta tecnología. Las cosas en 2025 siguen igual.

Puso de ejemplo algunos proyectos que se llevaban a cabo entonces: «Coches que se conduzcan solos u ordenadores que sean capaces de ganar al juego del go». En la actualidad, ya hemos visto esos avances de la IA.

En varias ciudades de Estados Unidos ya se han puesto en marcha esos taxis sin conductor y, poco después de la intervención de Hawkings en Cambridge, un ordenador fue capaz de vencer al campeón mundial de go, un juego oriental que se consideraba demasiado difícil para estas máquinas.

Fuente: elespanol.com