El cofundador de Apple advierte que la inteligencia artificial podría ser la herramienta definitiva en manos de quienes buscan manipular, estafar o desinformar. Un aviso con resonancia profética en un mundo cada vez más automatizado y menos comprensible

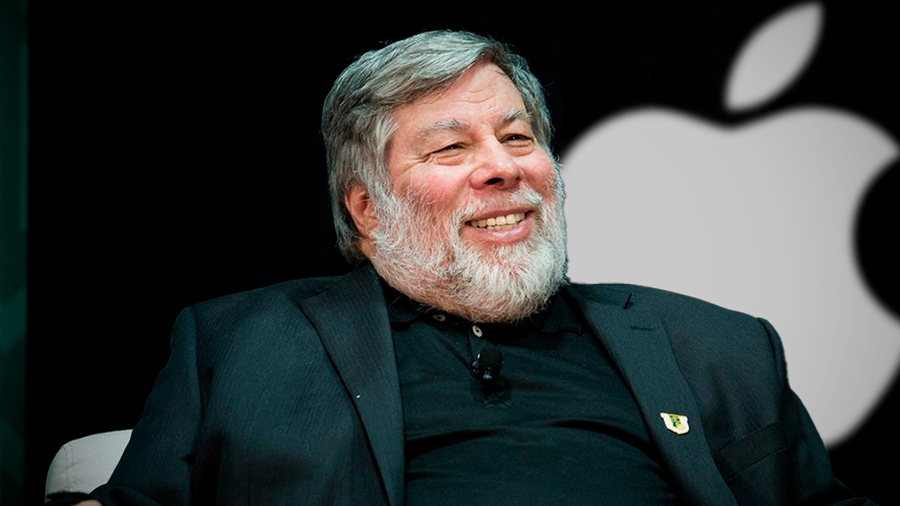

En la era de las máquinas que aprenden por sí solas, incluso los arquitectos del futuro sienten vértigo. Steve Wozniak, uno de los pioneros de la revolución informática, ha alzado la voz con la gravedad de quien ha visto nacer una nueva forma de poder sin comprender del todo su rumbo.

“La inteligencia artificial es tan inteligente que quedará a merced de malas personas”, ha asegurado el ingeniero estadounidense, reflejando una inquietud que no ha dejado de crecer entre científicos, programadores y tecnólogos. Y lo dijo no ayer ni hoy, sino en 2023, cuando ya vislumbraba el abismo al que nos acercamos con fascinación y temor.

La advertencia de Wozniak resuena con más fuerza hoy que nunca, en un contexto en el que incluso líderes de empresas punteras en IA admiten su desconcierto ante los modelos que ellos mismos han desarrollado.

Dario Amodei, CEO de Anthropic, la compañía detrás del modelo Claude, reconocía hace poco: “No tenemos ni idea de cómo funciona la Inteligencia Artificial”. Esta afirmación, lejos de ser tranquilizadora, siembra aún más dudas sobre un fenómeno que evoluciona con una rapidez vertiginosa y con un nivel de opacidad alarmante.

Tergiversando la realidad

Para Steve Wozniak, la amenaza más insidiosa de la inteligencia artificial no reside en su inteligencia per se, sino en la maleabilidad con la que puede ser dirigida hacia fines oscuros. En sus propias palabras, la IA “está abierta a los malos jugadores”, un eufemismo para referirse a estafadores, desinformadores y agentes maliciosos que ya no necesitan grandes infraestructuras ni habilidades técnicas sofisticadas para sembrar el caos.

La capacidad de estos sistemas para generar texto, voz e incluso imágenes indistinguibles de lo humano convierte el fraude digital en un fenómeno mucho más difícil de detectar, elevando el engaño a una escala industrial. Ya no se trata de simples correos electrónicos con errores ortográficos; ahora hablamos de mensajes persuasivos, vídeos con rostros clonados o declaraciones falsas atribuidas a figuras públicas que circulan con la apariencia de autenticidad total.

En este contexto, modelos de lenguaje avanzados como ChatGPT representan una herramienta de doble filo. Por un lado, democratizan el acceso a la información y la automatización, pero por el otro, permiten generar contenidos que imitan el estilo, la coherencia e incluso el tono emocional de un ser humano. Esa capacidad para articular discursos convincentes es lo que, según Wozniak, convierte a estas herramientas en armas peligrosamente eficaces en manos equivocadas.

El problema no es que la IA piense por sí sola —porque no lo hace—, sino que produce resultados tan refinados que puede usarse para fabricar realidad alternativa con una precisión que antes solo era posible en los estudios cinematográficos. Y en un mundo donde la verdad ya es frágil, el potencial manipulador de estos sistemas no hace sino erosionar aún más las fronteras entre lo verdadero y lo falso.

Etiquetar la IA

Ante este panorama, Wozniak se ha mostrado partidario de etiquetar de forma obligatoria todo contenido generado por inteligencia artificial, un paso necesario para preservar la integridad informativa.

Además, ha solicitado a los organismos reguladores que impongan responsabilidades a las grandes tecnológicas, cuya impunidad parece crecer al mismo ritmo que su influencia global.

Y aún con todo, Wozniak no aboga por detener el progreso, sino por educar al ciudadano común para que pueda defenderse ante una maquinaria cada vez más sofisticada. “Podemos detener la tecnología”, dijo, “pero lo más importante es preparar a las personas para reconocer el fraude y proteger su privacidad”. No es una alusión al miedo, sino a la lucidez: en una época donde los algoritmos escriben poemas, imitan voces y definen políticas, el conocimiento es el último bastión de la libertad.

Fuente: nationalgeographic.com.es