Es la pesadilla de todo conductor: un peatón que parece salir de la nada y se pone delante del coche, dejando solo una fracción de segundo para frenar o girar el volante y evitar lo peor. Algunos coches disponen ya de sistemas de cámaras que pueden alertar al conductor o activar el frenado de emergencia. Pero estos sistemas aún no son lo bastante rápidos ni fiables, y tendrán que mejorar mucho si se pretende emplearlos en vehículos autónomos en los que no haya un ser humano al volante.

La mayoría de las cámaras actuales se basan en cuadros (fotogramas), es decir, toman instantáneas a intervalos regulares. Las que se utilizan actualmente para ayudar al conductor en los coches suelen captar entre 30 y 50 fotogramas por segundo y una red neuronal artificial (un tipo de sistema de inteligencia artificial) puede entrenarse para reconocer objetos en sus imágenes: peatones, bicicletas y otros vehículos. Pero si algo ocurre durante los 20 o 30 milisegundos que transcurren entre dos instantáneas, puede que la cámara lo vea demasiado tarde. La solución sería aumentar la cantidad de fotogramas por segundo, pero eso se traduce en más datos que hay que procesar en tiempo real y más potencia de cálculo.

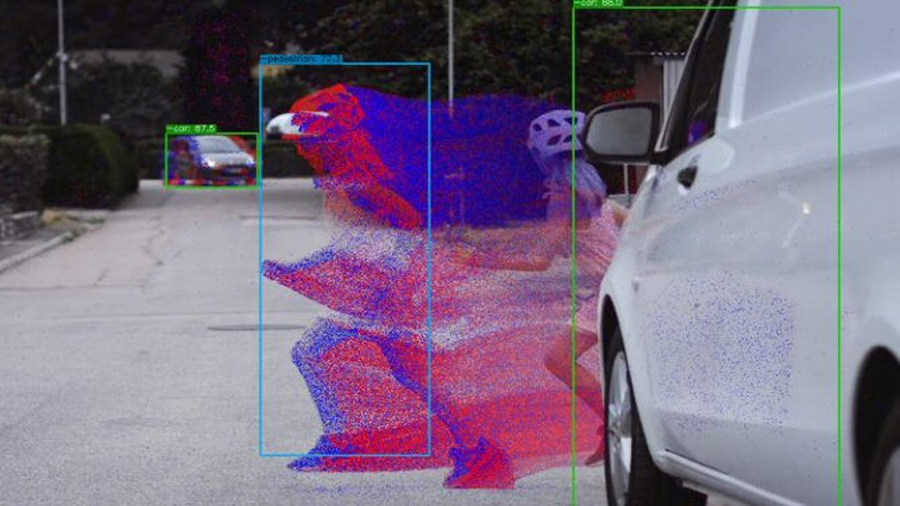

Las cámaras de eventos son una innovación reciente basada en un principio diferente. En vez de captar una cantidad constante de imágenes cada segundo, tienen píxeles inteligentes que graban información cada vez que detectan movimientos rápidos. De este modo, no se pierden ningún suceso repentino entre fotogramas y logran detectar obstáculos con mayor rapidez. También se llaman cámaras neuromórficas porque imitan la forma en que los ojos humanos perciben las imágenes. Pero tienen sus propios defectos: pueden pasar por alto cuerpos que se desplacen lentamente y sus imágenes no se convierten fácilmente en el tipo de datos que se utiliza para entrenar algoritmos de inteligencia artificial.

Daniel Gehrig y Davide Scaramuzza, del Departamento de Informática de la Universidad de Zúrich (UZH) en Suiza, idearon un sistema híbrido que combina lo mejor de ambos mundos: incluye una cámara estándar que recoge 20 imágenes por segundo, una frecuencia de imagen relativamente baja en comparación con las que se utilizan actualmente. Sus imágenes son procesadas por una inteligencia artificial entrenada para reconocer vehículos y peatones. Los datos de la cámara de eventos son examinados por otro tipo de inteligencia artificial, especializada en analizar datos tridimensionales que cambian con el paso del tiempo. Las detecciones de la cámara de eventos se utilizan para anticiparse a las detecciones de la cámara estándar y también para mejorar su rendimiento. El resultado es un detector visual capaz de detectar objetos con la misma rapidez que una cámara estándar que tomase 5.000 imágenes por segundo, pero que requiere el mismo flujo de datos que una cámara estándar de 50 imágenes por segundo.

El equipo probó su sistema comparándolo con las mejores cámaras y algoritmos visuales que existen actualmente en el mercado de la automoción, y ha constatado que permite realizar detecciones cien veces más rápidas y además reduce la cantidad de datos que deben transmitirse entre la cámara y el ordenador de a bordo, así como la potencia de cálculo necesaria para procesar las imágenes sin que ello afecte a la precisión.

Gehrig y Scaramuzza exponen los detalles técnicos de su nuevo sistema para detectar peatones y evitar atropellos en la revista académica Nature, bajo el título “Low Latency Automotive Vision with Event Cameras”.

Fuente: noticiasdelaciencia.com